OtterHD un modello multimodalità ad alta risoluzione

Scopri la fusione di arte e tecnologia con la nostra immagine esclusiva OtterHD. Un'opera d'arte che illustra brillantemente il concetto di alta risoluzione e variazione dei pixel, perfetta per appassionati di grafica e tecnologia.

L'evoluzione nel campo dell'intelligenza artificiale ha portato alla creazione di modelli sempre più sofisticati e ad alte prestazioni. Recentemente, un team di ricercatori composto da Bo Li, Peiyuan Zhang, Jingkang Yang, Yuanhan Zhang, Fanyi Pu, e Ziwei Liu, ha sviluppato un modello multimodalità denominato OtterHD-8B. Questo modello si distingue per la sua capacità di comprendere immagini ad alta risoluzione, un aspetto fondamentale per l'analisi dettagliata delle immagini.

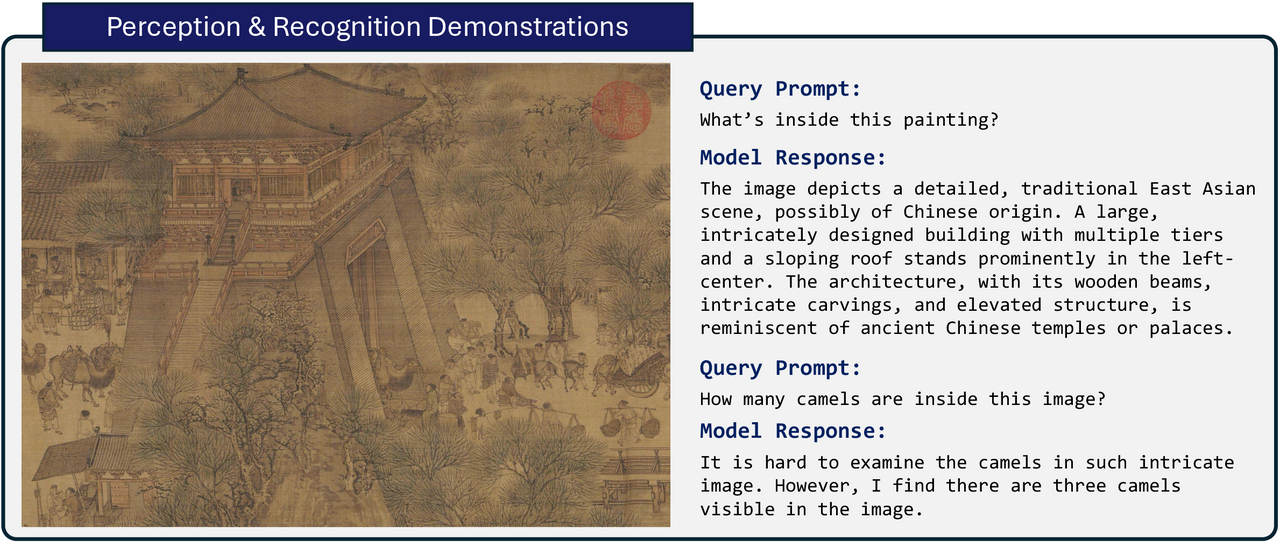

L'obiettivo principale di OtterHD-8B, un Large Multimodal Model (LMM), è quello di elaborare immagini nella loro risoluzione nativa. Ciò consente al modello di cogliere dettagli minuti che sarebbero altrimenti persi in processi di ridimensionamento. Per valutare le capacità di OtterHD-8B e modelli simili nel rilevare piccole caratteristiche in immagini ad alta risoluzione, gli autori hanno proposto un nuovo benchmark denominato MagnifierBench.

La maggior parte dei modelli multimodalità (LMM) attuali processa immagini a risoluzioni fisse, come 224x224 o 336x336 pixel. Questo comporta la necessità di ridurre e rimodellare le immagini ad alta risoluzione, oscurando caratteristiche dettagliate e impedendo al modello di comprendere questi particolari. Inoltre, le tecniche standard per aumentare la scala dei LMM si concentrano principalmente sull'ampliamento del decodificatore di testo, mantenendo invariato l'encoder delle immagini.

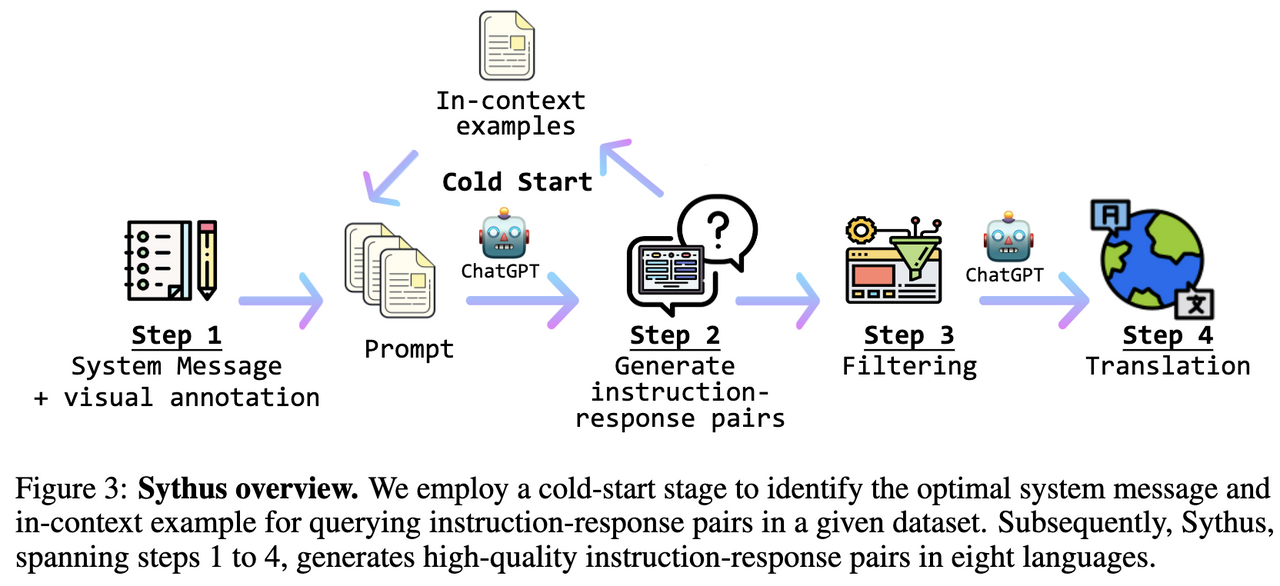

Gli autori hanno migliorato il modello Fuyu-8B introducendo OtterHD-8B, progettato per elaborare immagini a risoluzioni variabili, fino a 1024x1024 pixel. OtterHD-8B è stato ottimizzato a partire da Fuyu-8B, con immagini che variano in dimensioni da 448x448 a 1024x1024 pixel.

Il benchmark MagnifierBench è stato costruito utilizzando immagini provenienti dal dataset Panoptic Scene Graph Generation (PVSG), che include dati video come riprese in prima persona di faccende domestiche. Gli annotatori hanno caratterizzato manualmente piccoli oggetti dal dataset per costruire 283 coppie di domande e risposte, includendo sia risposte a scelta multipla che libere.

Risultati ottenuti con OtterHD-8B

OtterHD-8B ha superato altri LMM come InstructBLIP, LLaVA, e Qwen-VL di dimensioni parametriche simili nel benchmark MagnifierBench. Studi di ablazione sulla risoluzione delle immagini hanno rivelato che lo schema di campionamento dinamico — l'addestramento con immagini di varie risoluzioni — generalizza meglio alle risoluzioni più elevate non viste durante l'addestramento, sottolineando il ruolo cruciale della flessibilità della risoluzione.

OtterHD-8B rappresenta un importante passo avanti nella comprensione di immagini ad alta risoluzione. La sua capacità di elaborare immagini a diverse risoluzioni apre nuove possibilità nell'analisi dettagliata delle immagini, un aspetto fondamentale in molti campi di applicazione dell'intelligenza artificiale.

Per ulteriori informazioni, si consiglia di visitare il repository GitHub di OtterHD